在当今数据驱动的世界中,高效运维大规模服务器集群对企业的成功至关重要。想象一下,仅由六人团队管理一万台服务器,同时处理大数据任务并确保服务不间断——这听起来像是一项不可能完成的任务。通过合理的策略、自动化工具和专业化分工,这完全可以实现。以下将详细探讨六人团队如何运维一万台服务器,专注于大数据处理及运维服务的关键方面。

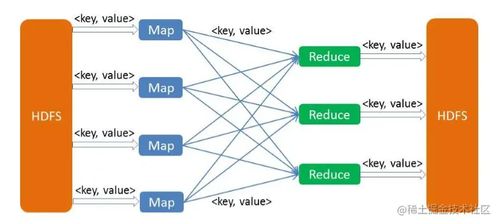

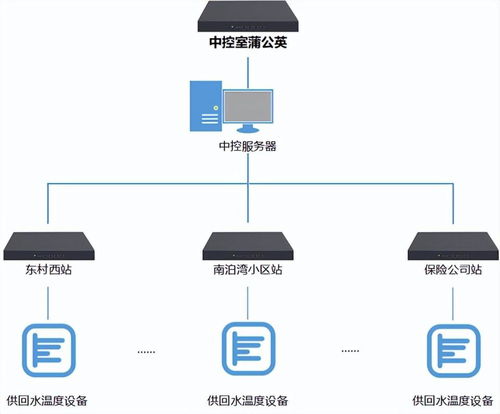

自动化是核心。运维一万台服务器时,手动操作已不可行。团队应部署成熟的自动化工具,如Ansible、Puppet或Kubernetes,用于配置管理、部署和监控。例如,自动化脚本可以处理服务器初始化、软件更新和故障恢复,减少人为错误并提高效率。结合CI/CD流水线,团队能快速部署大数据应用,如Hadoop或Spark集群,确保数据处理流程顺畅。

监控和日志管理至关重要。使用集中式监控系统,如Prometheus或Zabbix,结合日志聚合工具如ELK Stack(Elasticsearch、Logstash、Kibana),团队可以实时跟踪服务器性能、资源使用率和异常事件。通过设置警报规则,六人团队能迅速响应问题,例如CPU过载或网络中断,从而最小化停机时间。在大数据处理场景中,监控还包括跟踪数据流水线,确保ETL(提取、转换、加载)作业高效运行。

第三,采用云原生和容器化技术。将服务器集群迁移到云平台或采用混合云架构,可以利用弹性伸缩功能应对数据高峰。容器化工具如Docker和Kubernetes能隔离应用,提高资源利用率,并简化大数据服务的部署。例如,团队可以使用Kubernetes编排大数据工作负载,自动扩展节点以处理数据激增,而无需手动干预。

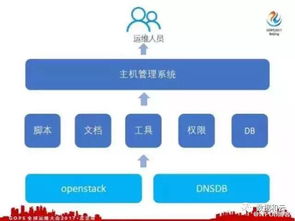

第四,专业分工和协作。尽管团队规模小,但成员应具备多样化技能,包括系统管理、网络工程、数据工程和安全。通过角色分工,例如一人负责监控和警报,另一人专注大数据管道优化,团队能高效协作。定期培训和知识共享也必不可少,以确保所有成员熟悉最新工具和最佳实践。

第五,安全与合规不容忽视。运维一万台服务器时,安全威胁可能来自多个方面。团队应实施零信任架构,使用防火墙、入侵检测系统和加密协议保护数据。对于大数据处理,数据隐私和合规性(如GDPR或HIPAA)必须优先考虑,确保数据处理符合法规要求。

持续优化和成本管理。通过分析性能指标和成本数据,团队可以识别瓶颈并优化资源配置。例如,使用机器学习预测资源需求,避免过度配置,从而在保证服务质量的同时控制成本。

六人运维一万台服务器并非神话,而是依赖于自动化、监控、云技术、分工协作、安全和优化的综合策略。在大数据时代,这种高效运维模式不仅能提升数据处理能力,还能为企业带来竞争优势。通过不断学习和创新,小团队也能驾驭大规模基础设施的挑战。